*该文被雪球删除

扎克伯格发布了自己的AI程序Jarvis (这个名字有点熟啊!哈哈!),可以控制家庭智能家居,实现开关家电,播放音乐,识别访客等功能。 这位大企业家亲自花时间写代码,可不是吃饱了没事干,更重要的是获取对AI的第一手资料和感受。

原文是英文,我做了一点节选,将就看看吧。 主要不是看故事,而是看他的实现思路和想法,为未来的人工智能概念寻找可能的途径。

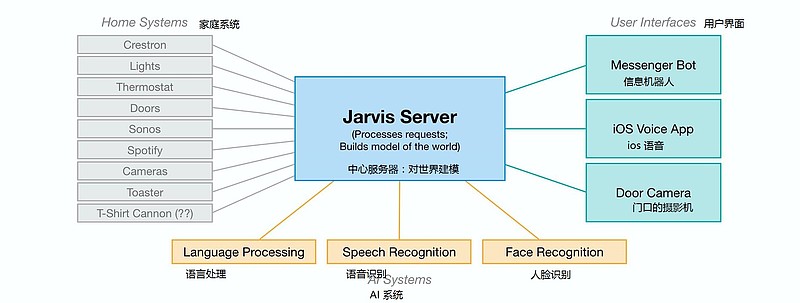

首先,扎克伯格百忙之中自己码代码的目的很明确:学习AI技术当前的状态(state),并了解到还有很长的路要走。掌握感性化的印象,并设想未来智能家居的概念。他通过建立了一个简单的AI,可以通过语音(talk),从电脑和手机控制智能家居,包括灯、温度、电器、音乐和安全。

编程过程中使用了自然语言处理(NLP),语音识别,人脸识别,强化学习,编程语言是python和PHP,objective C 。

思路: 连接家庭

首先一个挑战是,每个系统都有不同的协议和语言。电灯,集热器,门锁和音乐,三星电视,NEST CAM等等。需要对API做反向开发,以便从电脑发出指令到设备。

很多设备都不能上网,但是可以使用联网的电源开关代替控制。

自然语言

实现用自然语言与电脑对话有两个步骤。首先可以通过字符信息(TEXT),之后通过语音,翻译成字符信息后再交给电脑。

最开始从读取关键字开始,如“卧室”、“灯”、“打开”,定义我的操作:打开卧室的灯。很快电脑需要学习同义词,如“family room” 或”living room“ 代表同一间房间。这需要建立一个能教给电脑新概念的方法。

对AI来说,理解概念最重要。如果我告诉AI:“打开我办公室里的空调“,意味着我和别人指的”办公室“ 不是同一间房间。 ——AI曾经出错过。如果未指定特定的房间,他需要知道你在哪,否则会错误的操作别人的房间。

音乐更复杂了,对于NLP而言,大量的关键词是一个困难。对于灯来说只有开关两个状态,而音乐有大量的状态(歌手,歌名等),难于查找和定位。如说:播放X,可能代表好多个意思。考虑到更多的关联情况,比如播放类似的歌曲,播放和XXX类似的歌曲,或者播放XXX的歌曲,这些指令听起来很近似,但意义完全不同。 播放特定的歌曲,推荐一个艺术家,或是建立一个playlist,通过正负反馈,AI可以学习这些差异。

对于AI来说,更多的内容有助于其理解开放性问题。我要求AI:“播放一些音乐“,通过查询我之前的播放记录,可能播放一些我不想听的东西。如果我认为不对,我告诉它”这个不是XXX,播放一些XXX“,他可以同时学习分类,并立即调整。AI同时知道我或别人在对他说话,所以可以针对每个人做些个性化的调整。 我发现我使用开放性问题比特定问题更频繁。

扎克伯格认为,目前没有任何商业产品可以实现上述功能,看起来是个大机会

视觉和人脸识别

机器视觉的问题:移动跟踪,物体识别,人脸识别。

人脸识别较为复杂,因为相比随机物品的识别,差异性更小。但是FB有大数据呀~ 所以这些经验可以用在安防摄影机,让AI认出你的朋友们并给他们开门。

我安装了几个摄影机在门口的不同角度。AI现在不能从其他角度分别人脸,所以需要多个角度合成。我使用一个服务器持续跟踪摄影机并进行两个过程: 首先,如果有任何人出现,做一个人脸识别,然后,查询数据来识别这个人是谁。如果识别了这个人,然后确认这个人在我想要的list里才开门,并告诉我它已经允许这个人进来了。

这种视觉AI用处很大,可以做很多事,比如知道你起床了并开始播放音乐,解决一些问题如“我在哪个房间里”,当我说“开灯”时,它就知道我在哪个房间,该开哪个房间的灯。

文字命令处理(信息BOT)

我做了一个移动端,可以遥控这个AI。指令通过一个消息BOT传输,这个不需要专门做个APP,只需要用FB的客户端即可(哈哈哈哈 果然是老板 市场都想好了)。 通过手机直接用FB messenger 输入文字或语音指令。

输入任何的自然语言给AI,或是用语音,语音会先转换成自然语言再处理。如果有人拜访我家,AI会发消息告诉我谁来了,或者告诉我什么时候我该做什么。

相比语音,我更爱使用文字命令控制AI,首先是因为语音会打扰他人,如果我需要做的事情和所有人有关,比如播放音乐,可能用语音更合适,但是如果做私人的事情当然还是用文字。同样的,我也希望AI用文字和我联系,因为语音也会干扰别人,而且用文字你会感到更踏实。当我用手机时,我通常会用文字命令。

这和我们使用whatsapp和FBMSGR的经验相同,文字信息的增长量远高于语音信息。这可能预见着未来AI产品不能单独聚焦于语音识别,还需要一个私人的文字命令接口。如果你允许使用私人的文字命令,使用现有的平台(如FBMSGER,在中国就是微信)会比自己做个APP更方便。我一直对AI的文字指令处理BOT非常乐观,这个经验让我更乐观了。

语音识别

虽然我认为文字命令更重要,但语音也起到很重要的作用。最简单的原因就是因为快。你不需要拿出手机,打开APP,再开始打字,只需要开始说。

我为AI的语音设立了一个独立的APP,可以持续听我说话。文字BOT虽然可以做很多事,但是语音的摩擦太多了。我放了一堆手机在不同房间里以便可以在不同的房间里操作(持续收听,不挂后台)。 看起来和亚马逊的ECHO很像,但是我惊讶于我和AI在不在家的时候的交流频率。所以用手机作为输入端比音箱更重要。

语音识别系统最近已经有了很大进步,但没有AI足够好的听懂会话内容。语音识别依赖于听你现在说什么和预测未来你说什么,所以结构化的语句比非结构化的语句简单得多。

另外一个有趣的限制——AI语音识别和机器学习系统,和大众的认识不同的是,他们是被高度优化在特定的问题上的。比如说,听懂一个人和电脑的对话和听懂两个人之间的对话是完全不同的。 如果你训练一个机器学习系统,使用google 的搜索大数据,他们会很难以处理FB上人和人之间的对话。在这个案例里,训练AI分别你在近距离的对话和在更远的房间对话是不同的。就像ECHO一样。 这些系统比你想象的还专精,这提示我们AI技术与通用系统还差很远。

在心理学角度看,如果你可以直接和一个system对话,你会比用文字控制一个电脑赋予更多的感情深度。一个有趣的观察是,自从我建立语音控制后,我也想加入一些幽默。 一部分原因是他现在可以和MAX互动,我希望这些互动让她娱乐,但是AI似乎感觉像是在和我对话。我交给他一些随机和家人开玩笑的东西,还加入了一些经典的玩笑句子等。

AI科技刚刚够成为伟大产品的门槛,而且会在接下来的few years中更好。同时,我认为最好的产品还能够便携以及私人的联系(指的就是TEXT)

FB开发环境

作为CEO,扎克伯格自己写的这个项目。他希望从中学到AI目前的状态,但是这不是FB专业工程师的水平。

我们的价值观是 move fast ,这需要你能够以最快的速度编辑一个APP。当然这也包含私人项目。公司可以建立有效率的内部工具来完成这些任务。

下一步

我今后会天天使用这个AI并加以改善,以及加入新功能。下一步,我要建立一个安卓APP,并设置更多的语音识别终端,连接更多家电。我喜欢用AI控制我的big green egg 做饭,或是用TSHIRT大炮射出一件新T恤。

长期来看,我认为这个AI可以训练自行学习新东西,而不是我来训练他做特定任务。我将会花另一年来做这项挑战,并聚焦于学习“学习”是如何工作的。最后当然是公开并建立一个FUND来推广新产品。

总结

建立AI是有趣的智力挑战,给我对AI工具的直接经验,这对未来很重要。

我认为未来5-10年AI系统会在很多感官上比人更精确,如视觉,听觉,触觉等。当然也包括语言。令人印象深刻的是这些工具的技术有多强大,今年的经验让我对预测更有信心。

与此同时,我们仍远未理解“学习”是如何工作的。我做的这些事情,包括自然语言,人脸识别,语音等,都是通过更多基础的认知科技的变量。我们知道给一个电脑更多例子,它就能认识的更精确,但不知如何从一个领域中取得一个idea并应用到另一个领域。

无论如何,AI与我们的想象既近又远。AI很近,可以做很多人类希望做的强力事情,开车,看病,探索行星,理解媒体。这些会造成很大的影响,但是我们仍然不知道什么是智能。

这是一个很大的挑战,这个挑战有机会教给我比我开始想象的更多的东西。这些年我学习了AI,也学了智能家居和FB的内部AI工具。这种挑战很有趣,感谢follow,明年会共享更多。

我的总结

扎克伯格提出了几个大问题:

首先,接口不规范的情况下,要采用特别的办法来控制。

然后他认为NLP是基础,但是基于文字的自然语言更好,因为有时候特别是在移动端使用语音是不合时宜的。——这其实提示我们,对于人工智能应用,还是巨头们能做,FB和微信,是做文字命令最好的平台。你可以这样理解,你的AI是一个微信用户,你用微信跟他聊天,他再控制设备。

最后就是AI在处理会话等问题上存在问题,不具有通用计算能力,这点还需要改进。

但是他非常自信,既然愿意花这么多时间来做,肯定不是没事干,而且测试中使用了FB的信息程序控制AI,意味着FB进入AI和智能家居领域已经列入日程。再结合人脸识别功能,未来FB这方面的应用会非常丰富(比如说,允许一个指定的好友开门)。这也就提示了我们关于人工智能应用的方向和可能的路径。